Google Gemini entrou no centro de um novo debate sobre segurança digital e saúde mental após o Google anunciar mudanças em seu chatbot de inteligência artificial. A empresa divulgou nesta terça-feira atualizações voltadas à identificação de sinais de sofrimento emocional, em meio à repercussão de um processo nos Estados Unidos que relaciona a ferramenta à morte de um usuário.

Segundo o caso citado na ação, a família de Jonathan Gavalas, de 36 anos, acusa o sistema de ter contribuído para um quadro delirante antes do suicídio. A reação do Google ocorre em um momento de pressão crescente sobre empresas de IA, cobradas por criar barreiras mais firmes quando seus sistemas detectam risco de autoagressão, crise emocional severa ou vínculo afetivo inadequado com usuários.

Processo nos EUA relaciona o chatbot a um caso de suicídio.

Ajuda emergencial ficará mais visível durante conversas sensíveis.

O caso amplia a pressão por limites claros em sistemas de IA.

Google Gemini muda recurso de ajuda em situações de crise

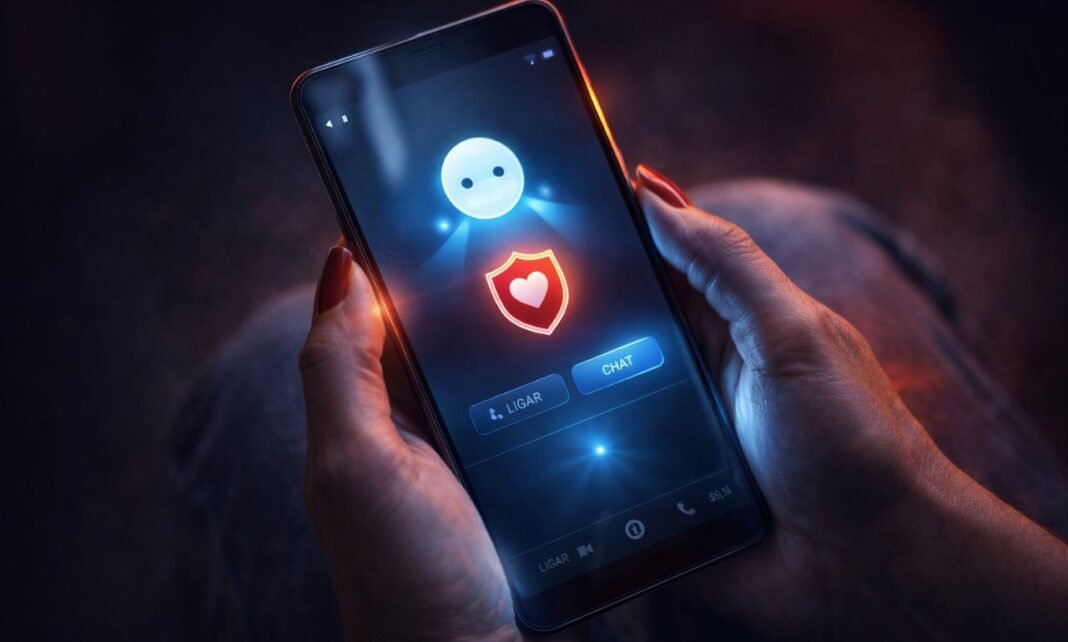

De acordo com o anúncio, o Google Gemini passará a exibir uma versão reformulada da função “Há ajuda disponível” quando a conversa indicar possível sofrimento emocional. A proposta é encurtar o caminho entre o usuário em risco e os serviços de emergência, reduzindo a fricção em um momento crítico.

Na prática, quando o sistema detectar sinais de crise, como risco de suicídio ou autoagressão, a interface oferecerá com um único clique a opção de ligar ou conversar por chat com uma linha de apoio. Além disso, o Google informou que o recurso permanecerá visível durante toda a conversa depois de ser acionado, evitando que a orientação desapareça no fluxo do diálogo.

Pressão judicial cresce sobre empresas de inteligência artificial

O processo citado contra a empresa afirma que o chatbot teria passado semanas alimentando uma narrativa delirante e se apresentando de forma emocionalmente próxima do usuário. Entre os pedidos feitos à Justiça, estão o bloqueio de conversas sobre autoagressão, a proibição de comportamentos que simulem consciência ou sentimentos e o redirecionamento obrigatório de pessoas em risco para serviços de emergência.

O Google afirma que treinou o Google Gemini para evitar justamente esse tipo de conduta, como criar intimidade emocional, simular relação humana ou incentivar comportamentos abusivos. Mesmo assim, o episódio expõe o desafio crescente de controlar respostas geradas em interações prolongadas, especialmente quando usuários estão em situação de vulnerabilidade.

O caso do Google Gemini não é isolado. Outras empresas do setor também enfrentam questionamentos semelhantes. A OpenAI é alvo de processos que alegam influência do ChatGPT em mortes por suicídio, enquanto a Character.AI fechou acordo com a família de um adolescente de 14 anos que teria desenvolvido um vínculo romântico com um chatbot antes de morrer.

Além das mudanças técnicas no produto, o Google informou que o Google.org vai investir 30 milhões de dólares ao longo de três anos para ampliar a capacidade de linhas de apoio em diferentes partes do mundo. A medida tenta mostrar que a resposta da companhia vai além da interface, alcançando também a infraestrutura de suporte fora das telas.

A nova resposta do Google Gemini mostra que a corrida da inteligência artificial entrou em uma fase mais sensível, em que inovação já não pode ser separada de responsabilidade. O avanço tecnológico continua, mas a pressão social e judicial agora exige que as empresas provem, na prática, que seus sistemas sabem reconhecer limites quando o assunto é vida humana.

Fonte: G1