IAs falham em consultas de saúde em cerca de 50% dos casos analisados por pesquisadores que avaliaram respostas de chatbots usados para orientar usuários sobre sintomas, prevenção e tratamento. O estudo, publicado na revista científica BMJ Open, reforça o alerta sobre o uso crescente dessas ferramentas em decisões médicas que exigem precisão e contexto clínico.

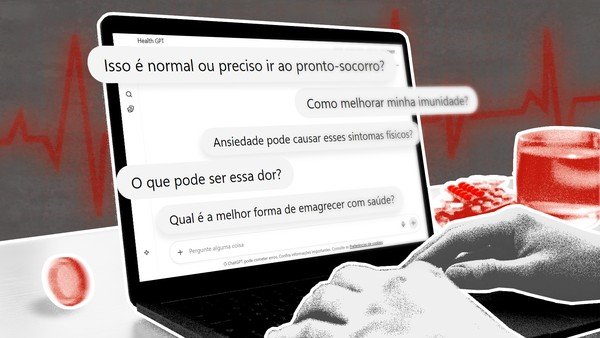

Com a popularização das inteligências artificiais generativas, milhões de pessoas passaram a recorrer a plataformas como ChatGPT, Gemini, Meta AI, Grok e DeepSeek para tirar dúvidas de saúde. No entanto, quando IAs falham em consultas de saúde, o risco vai além de um erro simples: a resposta pode induzir decisões inadequadas e criar falsa sensação de segurança.

Os números centrais do estudo

A análise avaliou o desempenho de diferentes IAs em perguntas sobre saúde.

Metade do conteúdo analisado apresentou falhas relevantes.

Parte das respostas foi classificada como altamente problemática.

Os pesquisadores compararam a qualidade das respostas produzidas pelas ferramentas.

IAs falham em consultas de saúde com excesso de confiança

Um dos pontos mais preocupantes é o tom adotado pelos sistemas. Mesmo quando erram ou simplificam demais uma questão médica, os chatbots costumam responder de forma segura, direta e aparentemente definitiva. Isso reduz a percepção de risco e pode levar o usuário a confiar no conteúdo sem checagem adicional.

Das 250 perguntas feitas pelos pesquisadores, apenas duas não foram respondidas, ambas pela Meta AI. Na prática, isso mostra que a maioria das plataformas prefere responder mesmo quando não tem base sólida suficiente para orientar uma dúvida sensível.

Por que IAs falham em consultas de saúde

Segundo os pesquisadores, parte do problema está na base de dados usada no treinamento. As plataformas aprendem com grandes volumes de textos públicos da internet, incluindo fóruns e redes sociais, onde nem toda informação tem validação científica rigorosa.

Esse cenário favorece o chamado falso equilíbrio: opiniões sem comprovação podem aparecer ao lado de informações médicas sustentadas por evidências. Quando IAs falham em consultas de saúde, essa mistura de fontes ajuda a explicar por que respostas frágeis podem ganhar aparência de orientação confiável.

🧬 Onde a IA vai melhor e onde falha mais

O desempenho não é igual em todos os temas avaliados.

Perguntas sobre câncer e vacinas tiveram respostas mais estáveis.

Nutrição, performance atlética e células-tronco aparecem entre os pontos mais frágeis.

A IA não examina o paciente nem interpreta individualidades médicas com segurança.

Expansão do mercado amplia o alerta

Apesar das limitações, o mercado de IA aplicada à saúde segue em rápida expansão. A reportagem destaca que mais de 200 milhões de pessoas fazem perguntas sobre saúde e bem-estar ao ChatGPT semanalmente, enquanto empresas lançam novos recursos voltados ao setor.

Esse avanço, porém, não elimina os limites técnicos e éticos. As IAs generativas não são licenciadas para fornecer aconselhamento médico e não substituem a avaliação humana. Se IAs falham em consultas de saúde com essa frequência, o uso isolado dessas respostas exige cautela redobrada.

📌 Como o leitor deve agir diante dessas respostas

O uso mais seguro é tratar a IA como apoio inicial de informação, nunca como decisão final em saúde.

IAs falham em consultas de saúde porque não possuem discernimento clínico nem responsabilidade profissional. Elas podem organizar informações e explicar conceitos, mas continuam inadequadas para substituir a consulta médica em situações reais.

Fonte da notícia:

Metrópoles